- Augmentation des émissions de CO2 de 3%

- Effondrement imminent...

- Des panneaux thermo-voltaïques transparents

- Le premier modèle numérique complet d'une bactérie

- La vie comme inversion de causalité

- Faire évoluer des mouches pour qu'elles sachent compter

- Une méduse artificielle avec des cellules de rat

- Ce qui est impossible pour l'oiseau ne l'est pas pour l'homme

- On peut stimuler par optogénétique le cerveau d'un singe

- Une momie écossaise faite de membres disparates

- Le QI des femmes a dépassé celui des hommes

- On pourrait prédire par le jeu de regards ce qu'on va dire

<- Revue des sciences précédente | Revue des sciences suivante ->

Revues : Pour la Science Brèves : Physique - Climat - Biologie - Santé - Technologie

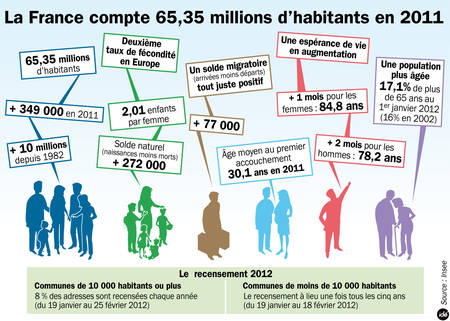

C'est la première revue des sciences faite sous wordpress et je tâtonne encore un peu, ayant profité de ces temps de vacances où l'information se raréfie pour cette migration d'un autre genre. C'est aussi les vacances pour les sciences semble-t-il, ce qui n'est pas toujours le cas à cette période. On peut se plonger dans les revues précédentes jusqu'en 2009 pour comparer, comme j'ai dû le faire, y trouvant un dépaysement certain. Pas grand chose, donc, à se mettre sous la dent cette fois (tout de même le premier modèle numérique d'une bactérie, écrire par la pensée ou avec les yeux, deviner du regard, etc.) mais s'il y a assez peu de nouvelles, il y en a de très mauvaises aussi bien pour les crises financière qu'écologique. De manière assez insensible il se pourrait qu'on assiste au basculement vers une géoingénierie à laquelle on se résout, de même que l'air conditionné se généralise, devant notre impuissance à ralentir l'augmentation de nos émissions de gaz à effet de serre. Ce n'est pas qu'il n'y ait des progrès continus des énergies renouvelables et qu'on ne puisse se passer du pétrole, mais on en trouve toujours plus, hélas, à des prix qui restent trop compétitifs. Du coup, la voiture électrique est un flop retentissant ! Alors que les nations de la Terre entière, plutôt mal en point, montrent qu'elles sont capables de se réunir pour de simples jeux sportifs (très marchandisés), la technologie viendrait ici compenser les limites du politique devenues flagrantes. Ce n'est pas ce qui empêchera pour autant l'effondrement d'écosystèmes entiers... Dans ce contexte de perte dramatique de biodiversité, la bureaucratie européenne fait preuve de son terrible aveuglement, la Cour de Justice européenne confirmant l'interdiction des graines traditionnelles (Kokopelli) ce qui est vraiment scandaleux de bêtise (il y a une pétition). Plus généralement, les perspectives se sont soudainement assombries sans événement majeur qu'une perte de confiance dans les instances internationales sensées nous tirer de tous les mauvais pas (et qui s'agitent encore pendant que le reste de la population décroche). Le début de l'été qui a été assez pourri sur le nord de la France a causé une grande sécheresse aux USA faisant monter le prix des céréales et donc poussant à l'inflation des prix. Ce sont ces moments de crise qu'on peut croire très conjoncturelles qui précipitent des tendances de fond, résultant malgré tout de l'augmentation de la population mondiale qui vient de dépasser les 7 milliards (et devrait aller jusqu'aux 9 milliards sans doute) ainsi que la hausse de la demande des pays les plus peuplés qui se développent rapidement. Il est d'ailleurs caractéristique que les premiers produits technologiques africains comme des chargeurs solaires commencent à pénétrer le marché US. Les évolutions ne sont pas linéaires mais alternent hausses et baisses dans un jeu entre les institutions et les marchés. Ce sont ces timides signes de reprise qui empêchent hélas de prendre des mesures radicales pour résoudre une crise qui paraît par moments se retourner toute seule de façon trompeuse, comme on l'avait bien vu en 1929 déjà, avec pour funeste conséquence de sembler légitimer des politiques de rigueur ne faisant qu'aggraver dramatiquement la situation (il faut être spécialement borné et dogmatique pour ne pas se rendre compte qu'on ne peut rembourser en s'appauvrissant - on ne peut tondre un oeuf - et qu'on ne fait ainsi qu'augmenter la dette, mécanisme bien connu de l'esclavage pour dette!).

On pourrait penser que les physiciens prennent des vacances bien méritées avec la découverte du siècle (à quel prix!) qui devrait valoir à Peter Higgs (et Robert Brout et François Englert) le Nobel sans aucun doute. Sauf que c'est aller un peu vite en besogne et qu'on pourrait découvrir juste après l'attribution du prix que ce n'était pas du tout le boson de Higgs... En effet, la seule chose sûre pour l'instant, c'est l'existence d'un boson neutre de 126 GeV. Il y a certes pas mal de raisons de penser qu'il correspond à ce qu'on cherchait mais il faudrait tout de même attendre au moins d'en déterminer le spin (qui doit être zéro), ce qui est le seul test concluant. C'est le propre des sciences de nous prendre à rebrousse poil et nous tenir en haleine devant des mystères qui sont longs à percer alors que la sphère médiatique s'emballe très vite. Il ne faut jamais se précipiter à comprendre mais les systèmes interconnectés et les médias globaux joints aux systèmes automatisées d'analyse en temps réel risquent d'accélérer ces phénomènes de mode et les fluctuations politiques ou sociales de façon encore plus catastrophique peut-être que dans la finance. Ceci dit, on apprend ce mois-ci que non seulement le stress bloque la pensée, ce qu'on savait déjà plus ou moins, mais que notre part de folie serait partie intégrante de nos performances cognitives. Si on ne pouvait pas croire à des conneries, on ne pourrait pas croire non plus à une vérité si souvent déroutante. Comme quoi, aussi étonnant que cela puisse paraître, deux jeux perdants peuvent en faire un gagnant...

Sinon, on pourrait se réjouir de l'arrivée de découpes laser de bureau ou de voir la liste de tout ce que le smartphone remplace (il y en aurait pour 1200$!). C'est effectivement, bien plus qu'un couteau suisse en poche, un outil universel tout comme l'ordinateur, un General Problem Solver. Les smartphones ne viennent pas en plus de tout le reste comme voudraient nous en persuader certains écologistes mais se substituent à beaucoup. Ce serait donc plutôt un facteur de décroissance, comme le numérique en général limité par la saturation, sauf qu'il ne faut pas se leurrer, c'est loin de suffire et encore plus de pouvoir compenser la croissance des pays les plus peuplés (l'inégalité serait plus soutenable assurément, tout comme de nous massacrer entre-nous!). En tout cas nous sommes entrés rapidement dans un autre monde, qui n'est pas sans séductions mais n'a certes pas que des bons côtés et dont les commandes nous échappent complètement. Par exemple, on ne sait s'il faut rire ou pleurer de vouloir organiser des rencontres par ADN, ce qui se fera à n'en pas douter, façon plus moderne de se fier au hasard pour rencontrer des inconnus. Il faudra bien s'habituer aussi au fait que le numérique nous expose à une transparence intrusive. Non seulement on s'expose sans façons sur le réseau mais il y a désormais de multiples moyens pour nous pirater avec le mobile, des webcams, les prises électriques, etc. Il y a pire, un scanner moléculaire (spectromètre à laser) portatif serait capable de détecter à moins de 50m si vous avez des quantités infinitésimales de poudre de cannabis (ou d'autres drogues ou explosifs bien sûr) au fond de vos poches ! Ce n'est pas ce qui pourra empêcher l'échec de la guerre à la drogue qui est patent (les prix baissent, les quantités consommées montent ainsi que la violence des mafias) mais de quoi donner des raisons aux polices de la prolonger inutilement (il sort une nouvelle drogue chimique toutes les 3 semaines!). On nage dans le même irréalisme bureaucratique avec l'obligation d'avoir un éthylotest dans la voiture, ce qui est un marché juteux dont on ne voit pas bien l'intérêt (qui soufflera dedans quand il a trop bu ?) mais qui produira à coup sûr des déchets dangereux par millions !

Pour la Science no 418, Epaves

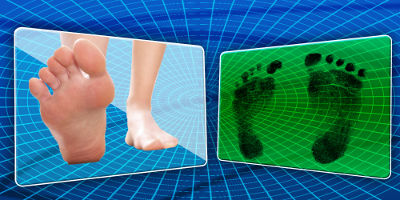

On s'insurge ici sur l'impudeur des tests de féminité et le rejet des compétitions féminines au-delà d'un niveau de testostérone jugé trop masculin alors que d'autres s'insurgent contre les athlètes voilées. Accepterait-on qu'un homme qui a un taux faible de testostérone concoure dans les catégories féminines ? Où que les femmes soient torse nu comme les hommes ? La question de la différence des sexes se pose à tous les niveaux !

Il faudrait rappeler que si les Grecs couraient nus (la gymnastique veut dire ce qui se pratique nu, les gymnosophistes étant les sages nus de l'Inde), c'était après avoir découvert qu'une femme avait participé à la course en se faisant passer pour un homme ! Le sport est confronté à toute une série de problèmes insolubles comme celui des prothèses pour éviter une course au dopage ou aux technologies sans exclure les handicapés. Il faut se dire que ce ne sont que des jeux dont les règles ont une bonne part d'arbitraire...

Article intéressant qui montre qu'il faut combiner les grands barrages avec des petits pour réduire leur ensablement, entre autres.

Mise au point salutaire d'Alain Riazuelo, qui s'est fait connaître par ses représentations de trous noirs, sur ces confusions habituelles ne tenant pas compte de l'expansion de l'univers notamment.

Ainsi, un sursaut gamma qui s'est produit il y a 12,2 milliards d'années (temps mis par sa lumière pour nous parvenir), quand l'Univers était âgé de 1,45 milliard d'années et que notre galaxie n'existait pas encore, se trouvait à l'origine à 4,65 milliards d'années lumières de notre portion d'espace mais désormais à 24,37 milliards d'années lumières de nous !

C'est toujours bizarre de parler de ce qui est par définition indétectable...

Ce neutrino serait "stérile", c'est-à-dire insensible à toute interaction hormis la gravitation, mais il pourrait se mélanger avec les trois saveurs connues de neutrinos (électronique, muonique et tauique) par le biais du phénomène d'oscillation. L'existence d'un quatrième neutrino aurait par ailleurs des conséquences cosmologiques, car il pourrait contribuer à la mystérieuse masse manquante de l'Univers.

- Le cerveau stressé, p70

La réponse au stress n'est pas seulement une réaction primitive, qui ne concerne que les aires cérébrales communes à de nombreuses espèces, de la salamandre à l'homme. En réalité, le stress affecte les facultés cognitives, les zones cérébrales les plus élaborées chez les primates.

Les recherches récentes ont révélé un rôle inattendu du cortex préfrontal, une structure cérébrale située derrière le front. Il est le siège des capacités cognitives les plus élaborées - la concentration, la planification, la prise de décision, l'intuition, le jugement... C'est la partie du cerveau apparue le plus tard au cours de l'évolution.

Le cortex préfrontal agit comme un centre de commande. Quand tout va bien, il maintient nos émotions et nos pulsions « primaires » sous contrôle. En revanche, un stress aigu déclenche une série d'événements chimiques qui réduisent son influence, tout en renforçant celle d'aires cérébrales plus anciennes. Nous pouvons alors nous retrouver en proie à une anxiété paralysante ou à des pulsions que d'habitude nous réussissons à contrôler : excès de nourriture et de boissons, consommation de drogues, frénésie dépensière... En d'autres termes, nous perdons le contrôle de nous-mêmes.

Proportionnellement plus gros chez l'homme que chez les autres primates, le cortex préfrontal représente un bon tiers du cortex humain. Sa maturation est plus lente que celle des autres zones cérébrales et ne s'achève qu'après l'adolescence. Il est responsable de la pensée abstraite. Grâce à lui, nous sommes capables de nous concentrer sur une tâche, tout en stockant des informations dans la mémoire de travail. Cette dernière nous permet de garder à l'esprit des données dont nous avons besoin pendant quelques instants, telle la retenue à reporter dans la colonne suivante lors d'une addition. Cette donnée est ensuite oubliée. Enfin, le cortex préfrontal inhibe les pensées et les actions inappropriées.

En réponse au stress, notre cerveau est inondé de composés chimiques « stimulants », telles la noradrénaline et la dopamine. Quand ils se déversent en grande quantité dans le cortex préfrontal, ils inhibent toute décharge neuronale : d'une part, ils réduisent l'efficacité de la transmission synaptique entre les neurones et, d'autre part, ils rendent les neurones eux-mêmes temporairement inaptes à transmettre les signaux électriques.

L'activité du réseau diminue, tout comme la capacité de régulation du comportement. Ces effets s'aggravent lorsque les glandes surrénales, contrôlées par l'hypothalamus, libèrent du cortisol - l'hormone du stress - dans le sang.

Des facteurs environnementaux peuvent avoir un effet similaire ; par exemple, le saturnisme (l'intoxication au plomb) a des conséquences physiologiques voisines de celles du stress et diminue les capacités cognitives.

Sous l'effet d'un stress prolongé (ou d'une répétition régulière d'événements stressants), le cortex préfrontal peut être perturbé durant plusieurs jours, voire plusieurs semaines. Des études ont montré que le réseau complexe des connexions entre neurones se développe dans les centres émotionnels primitifs, telle l'amygdale. Simultanément, les aires cérébrales impliquées dans le raisonnement (philosophique, mathématique...) rétrécissent au sein du cortex préfrontal, car des neurones meurent.

Le stress augmente le risque de dépression et de comportement addictif, tel le tabagisme, chez la femme. Chez l'homme, le stress exacerbe les envies et perturbe les comportements régulés par les ganglions de la base, entraînant des tics ou des mouvements stéréotypés (se ronger les ongles, se mordiller les joues...).

Il est important d'avoir conscience qu'il y a un rapport étroit entre l'absence de stress et l'intelligence. La réflexion a besoin de tranquillité et de temps. L'animal apeuré n'a pas le temps de penser, pas plus que nous dans les mêmes circonstances. Il y a un rapport direct entre l'intelligence, la liberté et la santé se définissant par l'absence de détermination immédiate, échappant à l'urgence. On peut dire qu'il y a le même rapport entre une certaine opulence et les créations de l'esprit fruits de l’oisiveté, c'est-à-dire hors des urgences vitales.

Il ne faut pas trop y compter mais c'est amusant ce paradoxe de Parrondo. Il faut quand même des conditions bien spéciales et que les deux jeux soient interdépendants (ici le même jeton).

Brèves et liens

Physique

cosmologie, astronomie, physique quantique

Les annonces de la découverte du boson de Higgs sont un peu prématurées car si on est sûr d'avoir découvert un boson qui pourrait être le boson de Higgs, il reste encore à l'établir. Cela pourrait être un autre boson.

Pour une fois Luis Gonzalez-Mestres a fait un billet très intéressant sur le boson de Higgs (passez les considérations sur "la particule de Dieu"). Il souligne la liaison avec la supraconductivité faisant du boson de Higgs un équivalent des paires de Cooper et les particules élémentaires un équivalent des quasi-particules.

L'impossibilité pour le champ magnétique de pénétrer dans un supraconducteur conventionnel, est liée au fait qu'au sein du supraconducteur le photon acquiert une masse par son mélange avec le champ de bosons définissant les paires de Cooper. La présence du champ magnétique au sein du solide devient alors impossible à cause du coût en énergie généré par cette masse du photon.

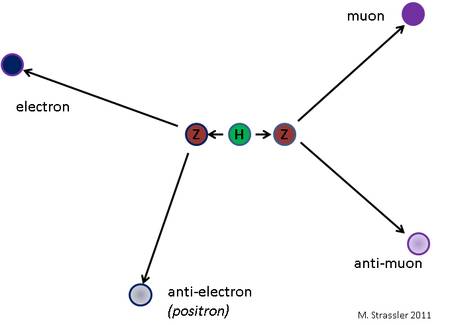

Dans le « mécanisme de Higgs », trois composantes du champ scalaire (une neutre et deux électriquement chargées) sont absorbées pour créer les composantes longitudinales des champs des bosons W et Z qui acquièrent ainsi des masses. Mais une quatrième composante (électriquement neutre) est épargnée par ce mécanisme et donne lieu au boson de Higgs scalaire tel qu'il a possiblement été observé par les expériences du CERN.

En effet, le champ de Higgs de la Physique des Particules est fait de deux doublets d'isospin, conjugées l'un de l'autre, avec charges électriques (0, +) pour l'un et (0, -) pour son conjugué. Ils se recombinent pour former un triplet d'isospin avec charges électriques (+, 0, -) plus un singulet électriquement neutre. C'est à une combinaison des deux modes neutres, que correspond le boson de Higgs possiblement observé par le CERN.

Voir aussi la mise au point de Laurent Sacco distinguant le champs de Higgs et le boson qui n'existe que sporadiquement car trop lourd alors que ce sont les gluons qui constituent la plus grande partie de la masse. L'interview qui suit est aussi intéressant (il reste à déterminer le spin du boson qui devrait être 0 pour un Higgs).

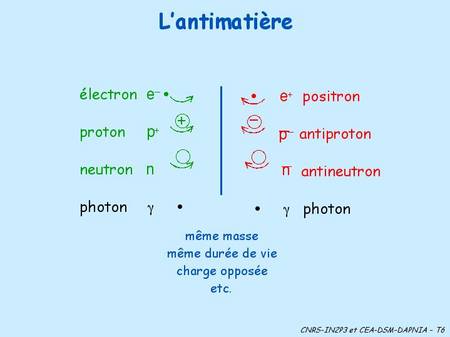

En 2010, la collaboration DØ de Fermilab indiquait que les propriétés de la matière et de l'antimatière manifestaient une différence de 1% lors de désintégrations de mésons B (c'est-à-dire des particules contenant des quarks beauté) en muons. Samedi, à la conférence ICHEP de Melbourne, la collaboration LHCb, du CERN, a présenté de nouveaux résultats qui, au lieu de confirmer cette anomalie, sont compatibles avec les prédictions du Modèle standard.

À la même conférence, les physiciens de LHCb ont également présenté le premier élément tendant à prouver que l'asymétrie entre la matière et l'antimatière apparaît lors de la désintégration B± -> K±K+K-.

Je me demande si on n'a pas tort de chercher une différence plus significative car c'est juste une question de temps dès lors qu'il y a une toute petite différence elle doit s'amplifier avec le temps et finir par éliminer toute l'antimatière qui se retransforme en énergie à rencontrer la matière, jusqu'à ce qu'elle produise un surplus de matière, etc. Il ne devrait rien exister, l'existence est un reste venant d'une dyssimétrie qui empêche son annihilation, de même qu'il ne devrait pas y avoir de charges positives et négatives si elles n'étaient piégées dans des atomes devenus neutres.

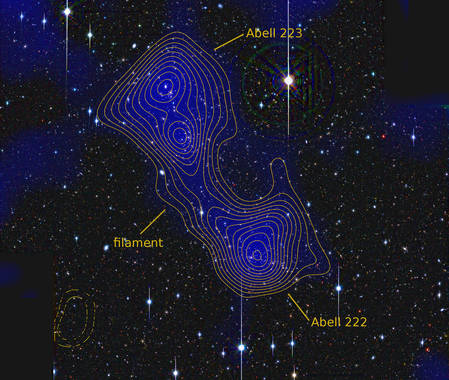

Un tel filament s'étendant entre les amas de galaxies Abell 222 et Abell 223 dévie en effet la lumière le traversant sous l'effet du champ de gravitation de la matière noire. En produisant des déformations caractéristiques des images des galaxies d'autant plus importantes qu'il y a de la matière noire, il permet de détecter la présence de cette matière invisible mais aussi d'estimer les quantités présentes.

C'est une preuve de plus en faveur de l'existence de la matière noire. On pense que des filaments similaires se trouveraient même dans les amas de galaxies, guidant des courants de matière normale et faisant croître des galaxies autrement que par des collisions et des fusions galactiques.

Parler de preuve me semble prématuré pour des observations indirectes basées sur des hypothèses. Les choses pourraient être plus compliquées ?

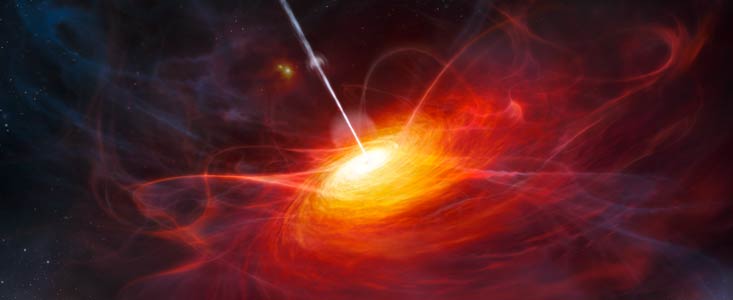

Jusqu'à présent, les astrophysiciens pensaient que les trous noirs super-massifs ne pouvaient influencer que leur environnement immédiat. Une équipe internationale - formée de chercheurs allemands, canadiens et américains - a découvert que les gaz diffus dans l'univers pouvaient "absorber" les rayons gamma émis par les trous noirs augmentant ainsi très significativement la température de ces gaz. Ce résultat surprenant a des implications importantes notamment sur la formation des différentes structures de l'univers.

Nous soutenons que les trois énoncés suivants ne peuvent pas toutes être vraies: (1) le rayonnement de Hawking est à l'état pur, (2) l'information est transportée par le rayonnement de la région proche de l'horizon, avec la théorie de l'énergie à faible champ efficace valable au-delà une certaine distance microscopique de l'horizon, et (3) l'observateur tombant dans le trou noir ne rencontre rien d'inhabituel à l'horizon. Peut-être la solution la plus prudente serait que l'observateur en chute se met à brûler à l'horizon ? Alternative semble exiger la dynamique de nouveaux notables qui causent Néanmoins violations de la physique

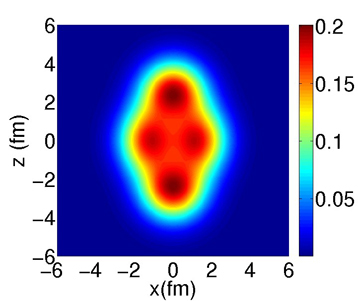

Le noyau atomique est généralement décrit comme une goutte de liquide quantique de l'ordre du millionième de milliardième de mètre de diamètre. Ce comportement de type liquide explique notamment la fission nucléaire, et s'applique préférentiellement aux noyaux lourds, c'est-à-dire ceux contenant beaucoup de nucléons (les neutrons et les protons). En revanche, les noyaux légers peuvent se comporter comme de minuscules "molécules" - ou agrégats - composés de neutrons et de protons à l'échelle du noyau. Cet aspect moléculaire permet de comprendre la synthèse stellaire du carbone-12 ou d'éléments plus lourds, nécessaires à l'apparition de la vie.

En résolvant des équations de physique quantique à l'échelle du noyau (et notamment l'équation de Schrödinger), les chercheurs ont démontré que, si un noyau léger peut présenter un comportement de type moléculaire (qui tend vers l'état cristallin), il adopte, lorsqu'il s'alourdit, un comportement de type liquide. Pour établir cette nouvelle théorie, les physiciens se sont inspirés des étoiles à neutrons(1). Plus on s'enfonce à l'intérieur de ces étoiles, plus on passe d'un milieu cristallin à un milieu liquide. Grâce à cette analogie, les physiciens ont identifié un mécanisme de transition de l'état liquide vers l'état cristallin du noyau. Lorsque les interactions entre neutrons et protons ne sont pas assez fortes pour les fixer au sein du noyau, celui-ci est alors dans un état de type liquide quantique où neutrons et protons sont délocalisés. À l'inverse, dans un état cristallin, neutrons et protons seraient fixés à intervalles réguliers dans le noyau.

Voir aussi Futura-Sciences.

Cette puce serait capable de mesurer la force de Casimir entre une paire de plaques parallèles en silicium, ce qui ouvrirait à l'exploitation de cette force de pression du vide dans des nanomachines.

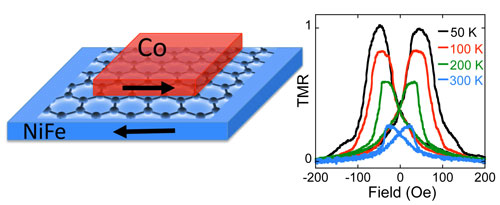

Ce serait un véritable saut technologique très utile pour l'électronique de spin notamment.

L'OLED « spintronique » pourrait être plus lumineux, moins cher et plus respectueux de l’environnement.

Le prototype déjà produit n’émet pour le moment que du orange mais d’ici quelque temps ces OLEDs spintroniques produiront du rouge, du bleu et du blanc.

Cette nano-antenne, les chercheurs de Langevin et Fresnel l'ont mise au point à partir de courts brins d'ADN synthétiques - leur taille : 10 à 15 nm de long. Les scientifiques ont greffé dessus deux particules d'or de 36 nm de diamètre ainsi qu'un colorant organique fluorescent. « Cette molécule émet des photons quand elle est stimulée par un laser, explique Nicolas Bonod, chercheur à l'Institut Fresnel et co-auteur de l'étude. Cette émission de photons est un phénomène naturel que nous sommes parvenus à amplifier avec la nano-antenne ».

Voir aussi Futura-Sciences et Techno-science.

Pour y parvenir, ils ont embarqué un atome de fer magnétisé dans une plus grosse molécule constituée de 51 atomes. En y appliquant un courant, ils ont pu changer sa charge magnétique ce qui a aussi altéré, de fait, sa résistance. Une simple mesure de cette altération permet la lecture du bit.

Au-delà de la technique employée, il faut bien se rendre compte qu'un tel support de stockage est outrageusement petit par rapport à ce qui se fait actuellement. Sur un disque magnétique, il faut trois millions d'atomes pour stocker un bit. Avec ce nouveau procédé, il serait possible de stocker 50 000 fois plus d'informations dans un même volume.

On pourrait utiliser les propriétés d'assemblage de l'ADN pour des nano-circuits électroniques grâce à sa métallisation.

Cela peut être utile dans de nombreux domaines et il suffirait de faire des fils nanométriques pour ensuite les décomposer en sphères.

Climat

Climat, énergies, écologie

De manière globale, les émissions de dioxyde de carbone, la principale cause identifiée du réchauffement climatique, ont augmenté de 3 % l'année dernière. Le nouveau record est donc en 2011 de 34 milliards de tonnes.

La croissance chinoise fait rêver nos constructeurs automobiles, mais sa croissance d'émissions fait moins rêver les écologistes ! + 9 %, soit 7,2 tonnes « par tête de pipe ». Cela fait qu'aussi incroyable que cela paraisse, la Chine n'est plus très loin de nos principaux pays industrialisés (entre 6 et 19 tonnes par habitant avec les USA à 17,3 en dépit de la récession et des fluctuations des prix des carburants fossiles).

Cet accroissement global de 3% des émissions, principalement soutenu par la croissance chinoise et ensuite par les États-Unis et l'Europe, dépasse la moyenne sur la décennie (2,7 %). Pour que la température globale ne grimpe pas de 2 degrés d'ici 2050 (l'objectif), on estime qu'il ne faut pas cumuler plus de 1500 milliards de tonnes sur cette période. Avec le rythme actuel, on aura atteint cette limite en 20 ans.

Le réchauffement dû à la fin de la dernière glaciation avait favorisé des plantes (Argousiers ou Hippophae rhamnoides) relâchant dans l'atmosphère l'azote sous forme de gaz hilarant (protoxyde d'azote), un gaz au puissant effet de serre (310 fois le CO2) produisant une accélération rapide du réchauffement que nous pourrions connaître aussi avec la fonte de l'Arctique...

Dans un article récemment publié dans Nature, les auteurs examinent l'accélération de la perte de biodiversité, les fluctuations climatiques de plus en plus extrêmes, l'interconnexion grandissante des écosystèmes et le changement radical dans le bilan énergétique global. Ils suggèrent que tous ces éléments constituent des précurseurs à l'apparition d'un état planétaire de seuil ou encore d'un point de basculement. Si cela s'avérait exact, ce que les auteurs prédisent pour le siècle en cours, les écosystèmes de la planète, en l'état de connaissances actuelles, pourraient rapidement et irréversiblement s'effondrer.

"Le dernier point de basculement dans l'histoire de la Terre est apparu il y a 12.000 ans, lorsque notre planète est passée de l'âge de glace, qui a duré 100.000 ans, à un état inter glacial", déclare Arne Mooers, professeur de biodiversité à SFU (Université Simon Fraser). "Alors, des changements biologiques les plus extrêmes menant à notre état actuel sont apparus en seulement 1000 ans. C'est comme passer de l'état de bébé à l'âge adulte en moins d'une année. Et la planète est en train de changer encore plus vite aujourd'hui".

L'étude conclut que nous serions avisés de ne pas transformer la surface de la Terre de plus de 50%, ou nous ne serions plus capables d'inverser ce processus. Nous avons aujourd'hui atteint 43% de ces changements, en convertissant les paysages en zones agricoles et urbaines.

Evidemment, beaucoup se disent que ce n'est pas la première fois qu'on nous prédit la fin du monde, ce qui n'est pas un argument quand il s'agit de savoir si c'est probable ou pas. Il faut mettre quand même un petit bémol à ce catastrophisme en partie justifié. Si nous devrions effectivement atteindre bientôt le point de non retour, l'effondrement devrait quand même prendre quelque temps. Il faut dire aussi que plus les écosystèmes sont complexes et plus ils sont résilients, il n'y a pas disparition de toute vie seulement simplification brutale vers un nouvel équilibre (transition de phase), mais il est certain qu'on prend des risques insensés. Dans les recommandations des scientifiques on ne sait s'il faut rire ou pleurer lorsqu'ils s'imaginent que les riches pourraient s'aligner sur les pauvres alors que tout prouve qu'on assistera à l'exact contraire ! Par contre, cela confirme que notre salut passe par les grandes villes.

Les 22 scientifiques de l'étude proposent aux gouvernements d'entreprendre quatre actions immédiates : diminuer radicalement la pression démographique ; concentrer les populations sur les zones enregistrant déjà de fortes densités afin de laisser les autres territoires tenter de retrouver des équilibres naturels ; ajuster les niveaux de vie des plus riches sur ceux des plus pauvres ; développer de nouvelles technologie permettant de produire et de distribuer de nouvelles ressources alimentaires sans consommer davantage de ressources.

La communauté scientifique a produit une énorme quantité de recherches montrant que nous avons un problème. Maintenant, nous sommes comme des médecins qui ont diagnostiqué la maladie du patient, mais sans donner des remèdes efficaces.

Les récifs coralliens se sont déjà effondrés il y a 4000 ans pendant 2600 ans.

Par ailleurs, il faisait plus chaud du temps des Romains que maintenant mais les records vont être dépassés assez vite.

Avec une accélération spectaculaire au Groenland.

L'augmentation des chutes de neige en Antarctique pourrait amortir le réchauffement climatique futur sur ce continent.

À l'aide d'images satellite et de modélisations numériques, les chercheurs ont montré que la hausse des températures en Antarctique impliquera des précipitations accrues et donc, une neige plus "blanche" qui réduira l'amplitude du changement climatique au centre du continent. Ces travaux révèlent une boucle de rétroaction négative agissant sur les températures, sous-estimée jusqu'à présent.

Les prévisions de réchauffement devraient être revues à la baisse de 0,5°C pour le centre du continent Austral.

Cependant, il y aurait un lac souterrain qui accélérerait la fonte et cela ne joue pas en Arctique où la fonte de la banquise a l'effet inverse. On créerait donc un plus grand déséquilibre entre le nord et le sud ?

En dépit des première études négatives, ensemencer les océans avec du fer serait efficace pour piéger le co2 à condition de le faire dans des zones riches en silice et en diatomées. 10% de nos émissions pourraient ainsi être absorbé.

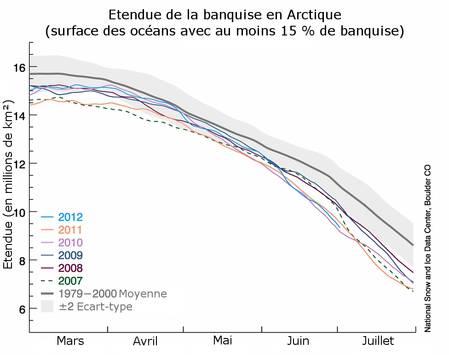

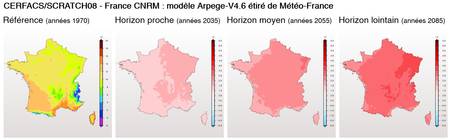

L'heure n'est plus à espérer une limitation de nos émissions mais à prévoir les adaptations nécessaires d'ici 2085 bien que les modèles restent très aléatoires au niveau régional !

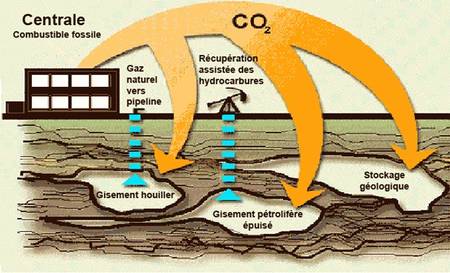

Mark Zoback et Steven Gorelink de la Stanford University viennent, en publiant une nouvelle étude dans la revue Pnas, de jeter un pavé dans la mare en remettant en cause cette stratégie de lutte contre le réchauffement climatique. Ils l'affirment : l'emprisonnement du CO2 ne serait pas viable à grande échelle !

Les industries pétrolières et gazières enfouissent, depuis longtemps, des eaux usées dans le sous-sol, à petites échelles, grâce à une technique semblable à celle du CCS. Or, plusieurs tremblements de terre survenus dans l'Arkansas, l'Ohio et à la frontière entre le Colorado et le Nouveau-Mexique ont déjà été attribués à cette méthode. Ces faits, liés à la rupture de faiblesses géologiques sous l'effet de la pression, ont dernièrement été confirmés par un rapport du National Research Council (NRC) présentant les risques sismiques liés au développement des nouvelles technologies énergétiques (géothermie, CCS, extraction de gaz de schiste, etc.). L'une des conclusions du document est nette : il existe des risques sismiques potentiels associés à l'emprisonnement du carbone.

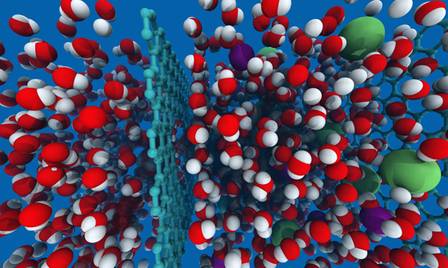

Le dessalement de l'eau de mer est coûteux en énergie. Des chercheurs du MIT viennent de montrer sur ordinateur que des membranes fabriquées avec du graphène seraient plus efficaces.

Les chercheurs ont ainsi déterminé qu'avec un feuillet de graphène possédant des nanopores de presque 1 nanomètre (nm) de diamètre, l'osmose inverse se produit des centaines de fois plus vite que dans les applications habituelles, ou encore qu'elle se produit à la même vitesse qu'avec des membranes classiques mais avec des pressions bien plus faibles. Remarquablement, si les nanopores étaient plus petits, le phénomène serait moins rapide et serait même impossible en dessous d'un diamètre de 0,7 nm.

Il reste tout de même deux problèmes à résoudre. Le premier est de parvenir à produire du graphène de façon massive et peu coûteuse. Le second est que l'on ne sait pas encore fabriquer des feuillets de graphène avec des pores aussi petits.

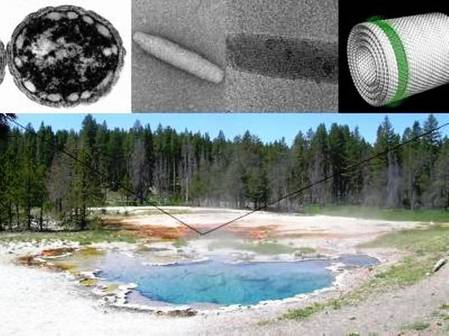

Leurs travaux concernant l'élucidation des mécanismes de photosynthèse découverts par l'évolution avec les fameuses bactéries sulfureuses vertes des sources chaudes. Certaines sont capables d'atteindre un rendement de presque 98 % dans la conversion de l'énergie solaire, rendant ridicules les cellules solaires commercialisées qui, elles, atteignent seulement 20 %.

Or, il y a quelques années, d'autres chercheurs avaient découvert que ces bactéries utilisaient pour la photosynthèse des structures moléculaires ressemblant aux nanotubes de carbone à double paroi faits de graphène. Ces structures sont appelées des chlorosomes, elles contiennent jusqu'à 250.000 molécules de chlorophylles.

Les chercheurs du MIT ont donc synthétisé des structures ressemblant aux chlorosomes. Il s'agit de nanotubes à double paroi entre lesquelles se trouvent des molécules colorées. D'un diamètre de 10 nm mais des milliers de fois plus longs, ces nanotubes sont le siège de processus excitoniques, c'est-à-dire faisant intervenir les excitons découverts par le physicien Yakov Frenkel. Ces excitons sont aussi présents dans le rubrène, une autre clé laissant elle aussi entrevoir de futures cellules photovoltaïques organiques efficaces et peu onéreuses.

Ouvrir le robinet permet de faire tourner les roues et d'emmagasiner de l'énergie hydroélectrique.

Lumière, chaleur et vibrations sont transformées en énergie grâce à un système de contrôle très sophistiqué qui permet à la puce de changer de source avant que celle-ci ne se perde, tout en conservant dans des condensateurs l'énergie accumulée grâce aux deux autres sources.

Voir aussi Futura-Sciences.

Cette cellule permet bien de convertir l'énergie solaire en énergie électrique tout en restant transparente. On ne voit pratiquement pas la différence avec une vitre ordinaire : 70 % de transparence.

Cette cellule solaire n'absorbe en effet que les rayons infrarouges (et laisse passer les fréquences visibles pour notre oeil). Évidemment, ces cellules n'ont pas le même rendement que les opaques. 30 % d'énergie perdue pour assurer cette transparence.

La bonne nouvelle toutefois est que le procédé de fabrication est très économique. On peut passer par une phase liquide et asperger une surface. Attendez-vous à voir cela débarquer sur le marché d'ici 5 ans et être répandu un peu partout d'ici une dizaine d'années.

Voir aussi Futura-Sciences.

Avec cette coque en plastique le temps de montage serait réduit des 2/3.

Une cellule DSC est un système photoélectrochimique inspiré de la photosynthèse végétale. Il est constitué d'un électrolyte (analogue à l'eau dans la photosynthèse) qui donne un électron sous l'effet d'un pigment excité par un rayonnement solaire (analogue à un pigment photosynthétique tel que la chlorophylle).

Le pigment photosensible est imprégné dans un matériau semi-conducteur fixé à la paroi transparente et conductrice située face au soleil, de sorte que l'électron libéré par le pigment diffuse jusqu'à la paroi conductrice à travers le matériau semi-conducteur pour venir s'accumuler dans la paroi supérieure de la cellule et générer une différence de potentiel avec la paroi inférieure.

Les DSC couramment utilisées sont composées d'un semi-conducteur en dioxyde de titane qui est imprégné de polypyridine au ruthénium qui joue le rôle de pigment photosensible. Toutefois, le développement des cellules DSC était jusqu'à présent freiné par la rareté et le coût du ruthénium alors que le zinc est un matériau bon marché qui coûte 1,5 € par kilogramme contre 2900 € par kilogramme pour le ruthénium.

Recycler les eaux usées d’un bâtiment pour faire pousser des algues puis produire de l’électricité et de la chaleur : c’est ce que propose la jeune société Ennesys, avec un système automatisé, qui a remporté un prix européen. En octobre prochain, une première installation sera mise en place à la Défense, près de Paris.

Le principe est simple : conduire des eaux usées (celle des toilettes, par exemple) dans un bassin où croissent des algues unicellulaires, qui se serviront de la matière organique comme nutriments. Ce bloom (amas gluant) est valorisable de plusieurs manières. De cette biomasse, on peut extraire de l’huile et en faire un biocarburant. La biomasse elle-même peut être brûlée dans une chaudière. Une troisième voie pourrait être la production d’hydrogène, grâce à une électrolyse de l’eau réalisée avec l’aide des réactions chimiques de la photosynthèse.

Avec des bassins placés sur les toits ou sur les façades, nous savons produire 120 kWH/m2/an. Pour les bâtiments, c’est une solution pour répondre aux exigences de la future norme RT 2020. Cette Réglementation thermique 2020, qui remplacera la RT 2012, imposera à cette date que tous les nouveaux bâtiments aient un bilan d'énergie positif, c'est-à-dire qu'ils doivent produire au moins autant d’énergie qu’ils en consomment. De plus, pour le circuit d’eau, deux réseaux devront être réalisés, l’un étant réservé à l’eau potable et l'autre pour les eaux grises (destinées aux toilettes, à l'arrosage ou au nettoyage des voiries).

Pour Ennesys, pas de doute, cette solution est plus avantageuse que les panneaux photovoltaïques.

En procédant à plusieurs traitements chimiques de la fibre de coton d'un T-shirt acheté dans le commerce, une équipe de chercheurs de l'University of South Carolina aux États-Unis est parvenue à utiliser le tissu comme source de stockage d'énergie. Si la technique n'est pas nouvelle, le procédé employé ici est à la fois moins onéreux et plus respectueux de l'environnement.

Pour cela, Xiaodong Li et son équipe ont fait tremper le tissu dans une solution de fluorure puis l'ont fait cuire à haute température en retirant l'oxygène dans le four pour éviter que la matière ne s'enflamme. Au bout de cette première étape, la cellulose du tissu s'est transformée en charbon activé et cela sans pour autant perdre sa souplesse.

Le tissu ainsi activé agit comme un supercondensateur ou condensateur à double couche qui offre une densité de puissance beaucoup plus importante qu'un condensateur normal. Et en ajoutant une couche de particules d'oxyde de manganèse de seulement quelques nanomètres d'épaisseur, l'équipe du laboratoire de l'University of South Carolina est parvenue à améliorer la résilience de ce tissu hybride.

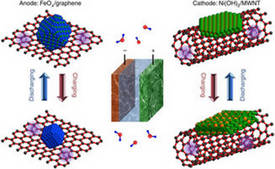

La mythique batterie nickel-fer, conçue il y a un siècle par Thomas Edison, abandonnée puis réétudiée au laboratoire, ressurgit grâce aux nanotechnologies, au graphène et aux nanotubes de carbone.

La batterie Ni-Fe a du mal à délivrer une forte énergie en peu de temps, ce qu'il faut par exemple quand il s'agit de faire tourner le démarreur d'un moteur thermique. Ces caractéristiques ont cantonné ces batteries à des usages restreints.

Une telle batterie pourrait se recharger en 2 minutes et demie et se décharger en moins de 30 secondes, ce qui pourrait vivement intéresser l'industrie automobile pour de futures voitures électriques.

Les chercheurs ont conservé le même principe nickel-fer qu'Edison pour les électrodes. Mais ils les ont couplées à des nanotubes de carbone et à du graphène, un matériau constitué d'une couche de carbone épaisse de seulement un atome. « Cela permet aux charges électriques de se déplacer rapidement entre les électrodes et dans le circuit extérieur. Le résultat est une version ultrarapide de la batterie nickel-fer »

Voir aussi Gizmodo.

Grâce à un système électromécanique, il serait possible de lisser le voltage de sortie, même en-dessous de 1 volt, ce qui serait un progrès décisif.

L'année prochaine, il suffira de seulement 45 minutes pour recharger de 10% à 90% cette batterie.

Il ne s'agira pas de bornes de recharge classiques, mais de véritables stations (comparables à celle que l'on fréquente trop souvent pour prendre de l'essence aujourd'hui). Le conducteur s'y arrêtera soit pour brancher sa voiture, soit pour échanger sa batterie, puisqu'elles sont amovibles sur certains véhicules, dont le Model S.

Les pneus de taille classique reposent sur des blocs de béton, eux-mêmes posés sur des plaques d'acier (au sommet des cubes blancs). L'ampoule reliant les roues s'allume lorsqu'un courant parcourt les plaques. L'électricité est donc transmise dans l'air sans aucun contact, les pneus servent de récepteurs.

Le transfert d'électricité sans fil repose notamment sur l'utilisation du couplage inductif. Les éléments conducteurs parcourus par un courant (par exemple les plaques métalliques équipées de dispositifs adaptés) s'entourent d'un champ électromagnétique. Or, celui-ci peut induire une force électromotrice lorsqu'il coupe un second conducteur (comme l'acier contenu dans les pneus). La prouesse des chercheurs est d'être parvenus à utiliser cette propriété à travers le béton, tout en faisant en sorte que de grandes quantités d'énergie puissent être transférées. Une puissance électrique, c'est-à-dire le produit de l'intensité du courant par la tension électrique, de 50 à 60 W a en effet été mesurée aux bornes de l'ampoule. L'efficacité de la transmission d'énergie aux pneus serait à nouveau supérieure à 80 %, voire 90 %.

Ces développements sont très intéressants mais la puissance électrique transmise par le dispositif devrait être multipliée par 100 avant qu'une voiture puisse rouler sur les autoroutes sans devoir effectuer des arrêts recharges...

Un consortium danois planche sur une version d'une petite voiture électrique modulaire, la QBeak, qui abritera une pile à combustible à méthanol. Ce concept baptisé MECC pourrait pousser l'autonomie à 800 km et descendre le temps de recharge à 3 mn...

Cela n'a rien à voir mais signalons qu'un Français propose une voiture qui se rembourse par les ristournes sur sa carte bleue...

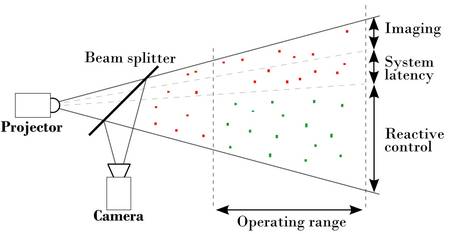

Mis au point par des chercheurs de l'université américaine Carnegie Mellon, un prototype de phare automobile réduit considérablement l'éblouissement produit par le faisceau lors de la conduite sous la pluie. Littéralement, il éclaire entre les gouttes...

Les algorithmes (exécutés à partir d'un processeur Core i7 quadruple coeur) comprennent :

- La localisation des gouttes de pluie filmées par la caméra.

- La mesure des paramètres tels que la taille, la position, la vitesse, l'accélération, etc. des gouttes de pluie détectées.

- La prédiction de la position future des gouttes de pluie détectées.

- Le contrôle des rayons émis par le projecteur afin d'éviter d'éclairer les zones où les gouttes de pluies vont tomber. »

Des algorithmes plus sophistiqués seront nécessaires pour optimiser la vitesse et prendre en compte le mouvement du véhicule, les turbulences, etc.

On ne voit pas bien comment cela peut marcher sur une distance de plusieurs dizaines de mètres ni sur tous les angles. Il serait étonnant que cela puisse devenir opérationnel.

Avec de nombreux capteurs, caméras et un télémètre laser, un tel système sera capable de détecter tout obstacle survenant pendant que vous êtes au volant et il corrigera automatiquement votre trajectoire si vous deviez percuter cet obstacle. Un copilote aisément intégrable aux voitures, d’après Sterling Anderson du Département d’Ingénierie Mécanique, car il pourrait utiliser la caméra et l’accéléromètre de votre smarpthone par exemple.

Au sud de la baie de Singapour, depuis le 29 Juin, ces 18 "supertrees" qui font de 25 à 50 mètres de haut sont recouverts de panneaux photovoltaïques et évacuent les gaz d'un réacteur à biofuel.

Biologie

évolution, génétique, éthologie, anthropologie, neurologie

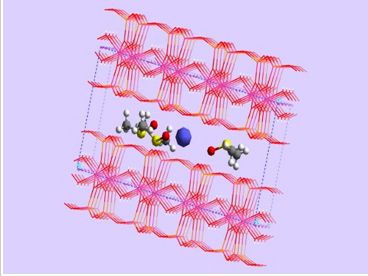

Cette bactérie pathogène (Mycoplasma genitalium) a été choisie car elle a le plus petit génome avec seulement 525 gènes. Ces 525 gènes pourraient être décrits par seulement 28 algorithmes ou fonctions vitales qui sont connectées entre elles, formant une totalité effective.

C'est une des grandes nouvelles du mois et l'occasion à la fois de donner un contenu concret au concept de complexité ainsi que de relancer une biologie synthétique qui faisait du surplace mais surtout de comprendre un peu mieux ce qu'est la vie dans sa dynamique même.

Voir aussi Sciences et Avenir.

C'est différent du précédent, combinant cette fois 10 organes électroniques (organs-on-chips) pour reconstituer le fonctionnement du corps entier.

Cette étrange bestiole est capable de nager grâce à des impulsions dès lors qu'elle est exposée à un courant électrique, tout comme son homologue vivant. L'équipe de scientifiques de l'Université de Harvard a littéralement réussi à `faire pousser' une couche de muscle sur une feuille de polydiméthylsiloxane grâce à des cellules de coeur de rat.

Le résultat de cette expérience ressemble d'une façon incroyable à une méduse commune appelée aussi Aurélie, méduse bleue ou méduse lune. Elle nage en contractant son corps par ondulations régulières.

Je n'ai pas lu assez dans le détail cette étude qui me semble à la fois intéressante et fautive. Intéressante car elle situe dans l'information la clé du vivant et surtout dans une inversion de causalité. Pour déterminer si un organisme est vivant, il suffirait de déterminer d'où vient la réaction.

Je n'ai pas lu assez dans le détail cette étude qui me semble à la fois intéressante et fautive. Intéressante car elle situe dans l'information la clé du vivant et surtout dans une inversion de causalité. Pour déterminer si un organisme est vivant, il suffirait de déterminer d'où vient la réaction.

Comme je le dis toujours, dans le vivant c'est l'effet qui devient cause par sélection après-coup et mémorisation génétique. Il semble cependant que ce soit une erreur de vouloir en faire une interprétation purement thermodynamique négligeant la temporalité de la sélection après-coup et de l'évolution. Ils arrivent cependant à déduire qu'on passe avec la vie d'une causalité bottom-up (d'une causalité locale conformément au réductionnisme physicaliste) à une causalité top-down (l'organisme agissant comme un tout, aucune de ses molécules n'étant vivantes en soi) se caractérisant par une structure hiérarchique où les niveaux supérieurs contraignent les niveaux inférieurs, où le circuit de l'information s'inverse (comme le circuit de l'argent est en sens inverse du circuit des marchandises), mais c'est sans doute insuffisant car un nuage aussi se déplace comme un tout sous l'action de vents extérieurs. L'information doit être considérée comme une réaction internalisée, ce qui est tout autre chose et ne se réduit pas toujours à des actions centralisées (sauf au niveau de l'ADN), certaines réactions étant locales sans être du même ordre que la causalité physique ou chimique car ce qui importe en biologie ce n'est pas la composition d'une molécule, ce qu'elle est mais ce qu'elle fait, le monde de la vie étant celui des finalités et du pragmatisme.

Enfin, dire qu'on passe avec les multicellulaires d'une causalité bottom-up caractérisant un groupe de cellules à une causalité top-down d'un organisme est vrai factuellement mais fait croire qu'il y a passage de l'un à l'autre alors que les multicellulaires sont issus d'une même cellule qui se divise et non d'un regroupement de cellules isolées. Il y a simple extension d'un principe premier, découlant du fonctionnement même de la cellule déjà.

La conclusion du papier, c'est que ce n'est pas la sélection darwinienne qui est la plus déterminante mais la capacité informationnelle et l'inversion de causalité, ce qu'on peut admettre mais l'origine de la vie est bien cependant dans la sélection darwinienne de molécules d'ARN autoréplicantes. C'est la sélection des réactions appropriés favorisant la reproduction qui est décisive, la sélection faisant intégralement partie de l'information, de sa validation, sorte de perception primitive. Cela n'empêche pas qu'il est très important de distinguer cette sélection darwinienne d'autres processus sélectifs ne faisant pas intervenir l'information.

Il est amusant en tout cas de voir qu'on peut avoir entre biologistes les mêmes oppositions entre auto-organisation néolibérale (émergence) et système hiérarchique autoritaire, les deux procédant d'une conceptualisation insuffisante de l'information et de la vie.

Cette étude se focalise seulement sur la modularité et les coûts de connexion mais cela revient bien à privilégier le réseau sur l'individu.

D'une certaine façon cela confirme l'effet de différentes temporalités sur l'évolution, ce qui fait que les plus adaptés sur le court terme ne sont pas les plus adaptés sur le long terme. Celui-ci oblige effectivement à prendre en compte le feedback, l'effet sur l'environnement et la raréfaction des ressources, ce qui veut dire aussi la primauté de la sélection de groupe sur la sélection individuelle.

En partant de mouches dénuées du sens du calcul, des scientifiques sont parvenus à faire évoluer ces drosophiles pendant quarante générations jusqu'à ce qu'elles démontrent qu'elles savaient compter. Ils espèrent ainsi remonter aux origines du sens des mathématiques. L'étude, qui n'a pas été publiée, a de quoi surprendre car certains détails restent (encore) inexpliqués.

Une première génération de ces animaux est placée dans une boîte et commence une séance d'entraînement de 20 mn, qui consiste à diffuser deux, trois ou quatre flashs lumineux. Lorsque deux ou quatre éclairs étaient présentés, les chercheurs secouaient la boîte, chose désagréable pour la mouche qui préfère s'envoler plutôt que de rester sur les parois. Dès que trois flashs étaient émis, aucune secousse n'était ressentie.

Quelques instants plus tard, on réitérait l'expérience, de manière à les conditionner comme les chiens de Pavlov. Les mouches se faisaient toujours piéger et ne réagissaient jamais, peu importe le nombre d'éclairs lumineux.

Il en a été de même pour ses enfants et leurs descendants... Jusqu'à la quarantième génération ! Dès lors, des drosophiles ont commencé à comprendre l'objectif de la manoeuvre et s'envolaient après avoir vu deux ou quatre flashs lumineux pour éviter la désagréable sensation d'un tremblement de boîte, tandis qu'elles ne s'inquiétaient pas à la diffusion de trois éclairs.

À partir de ces données extraites de l'ADN, les chercheurs espèrent remonter un peu plus loin dans les mutations génétiques à l'origine de notre capacité pour les mathématiques.

Cela paraît à la fois très naïf et très mystérieux...

Le séquençage de l'ADN de spermatozoïde a révélé qu'ils varient de façon étonnante (principalement par recombinaisons). Cela explique que les spermatozoïdes ne sont pas tous viables et certaines infertilités masculines. Comme il y a aussi des modifications épigénétiques intra-utérines, on voit qu'il n'y a pas de transmission intégrale du patrimoine génétique.

Le séquençage de l'ADN de spermatozoïde a révélé qu'ils varient de façon étonnante (principalement par recombinaisons). Cela explique que les spermatozoïdes ne sont pas tous viables et certaines infertilités masculines. Comme il y a aussi des modifications épigénétiques intra-utérines, on voit qu'il n'y a pas de transmission intégrale du patrimoine génétique.

Voir aussi Futura-Sciences.

Lorsque les termites âgées n'ont plus la force de se défendre avec leurs mâchoires elles explosent en tuant leurs agresseurs mais leur sacrifice est d'autant plus meurtrier qu'elles ont amassé avant des produits toxiques faisant des tâches bleues sur leur abdomen. C'est une illustration du suicide dans les espèces sociales ainsi que de l'utilisation du vieillissement pour protéger les plus jeunes.

Voir aussi Techno-Science.

Ce poisson à l’allure impressionnante vit entre 1000 et 3000 m de profondeur, dans la complète obscurité des abysses. Il est particulièrement connu pour l’appendice lumineux qu’il porte au-dessus de sa tête, et qui lui permet d’attirer ses proies.

Lorsque les scientifiques commencèrent à remonter des baudroies abyssales, ils furent surpris de ne trouver que des femelles, qui semblaient presque toutes avoir des petits parasites attachés à elles. Il s’avéra que ces « parasites » étaient en fait ce qu’il restait des mâles. Lorsqu’ils naissent, les mâles baudroies, beaucoup plus petits que les femelles, n’ont d’autre raison de vivre que de trouver une compagne. Et lorsqu’ils ont la chance d’en croiser une dans l’obscurité, ils s’accrochent à elle en la mordant, pour ne plus jamais lâcher prise. Commence alors un étonnant processus de fusion, au cours duquel le poisson va perdre progressivement ses organes pour se fondre dans le corps de sa partenaire. Il finira réduit à la plus simple expression de sa masculinité, en devenant une paire de testicules que la femelle utilisera lorsqu’elle souhaitera féconder ses œufs.

Généralement, les baudroies abyssales sont donc affublées de plusieurs mâles plus ou moins fusionnés attachés au corps.

Les extra-terrestres sont parmi nous. Comment peut-on inventer plus étrange ?

Les champs magnétiques agiraient sur des cristaux ferromagnétiques de taille micrométrique, probablement de la magnétite, présents dans le milieu intracellulaire et fermement liés aux membranes plasmiques situées à proximité. Ainsi, tout changement d'orientation des cristaux induit par une rotation du champ magnétique pourrait provoquer l'apparition de stress mécaniques au niveau des parois cellulaires. Ils entraîneraient une modification, par le biais de protéines adaptées, du potentiel électrique membranaire, générant ainsi un signal qui se propagerait jusqu'au système nerveux central.

Ce n'est pas si neuf mais cette capacité d'orientation notamment des oiseaux explique qu'ils soient perturbés à proximité des lignes électriques.

Contrairement à ceux de l'Homme, les télomères des tortues Luth ne raccourciraient pas avec l'âge, ce qui pourrait ainsi contribuer à leur remarquable longévité. Par ailleurs, un lien a été établi entre la durée des migrations et le nombre d'oeufs pondus : il est plus important lorsque les reptiles ont passé 3 ans en mer. Les tortues, parties pendant 2 ans, présenteraient en effet des télomères plus courts.

Restaurer ses réserves énergétiques en un temps limité entraînerait un coût physiologique important pour l'animal et, in fine, un impact négatif sur l'effort reproducteur de la saison. Les télomères semblent donc être un lien entre les différentes stratégies de migration et l'effort de reproduction des tortues Luth en Guyane.

Un argument de plus pour que le vieillissement soit un processus finement réglé par l'évolution et l'optimisation de groupe, en particulier avec la longueur des télomères.

Certains dinosaures du groupe des coelurosaures, à l'image du vélociraptor, arboraient possédaient des plumes. Une nouvelle étude tend à démontrer que tous les dinosaures carnivores en auraient été équipés, au moins partiellement. Cette annonce fait suite à la découverte de protoplumes sur un fossile de Megalosauroidea, exceptionnellement bien conservé, mis au jour en Allemagne.

Leur apparition serait aussi vieille que celle des dinosaures, puisqu'elle se rencontre au sein des deux plus anciens groupes (ornithischiens et saurischiens).

Des oeufs de dinosaure ovoïdes, donc semblables à des oeufs de poule, viennent d'être découverts. Datant du Crétacé supérieur, vieux de 70 à 83 millions d'années, ces fossiles fournissent de nouvelles informations sur l'évolution des dinosaures et des oiseaux. Ils auraient été pondus par un petit théropode en avance sur son temps qui n'aurait possédé qu'un seul oviducte, comme les oiseaux.

![]()

Dans les deux premiers tests, la bonne réponse est associée à une relation de cause à effet assez simple : une bille qui tombe au fond de l'eau fait monter le niveau. Dans le troisième test, l'action efficace consiste à jeter une bille dans un tube qui est apparemment sans relation avec celui où se trouve l'appât (ou le jeton), puisque la jonction en U est masquée. La relation de cause à effet n'est pas clairement visible. Selon le terme des chercheurs, ce troisième test est « contre-intuitif ».

Pourquoi cet aspect contre-intuitif est-il plus dérangeant pour l'oiseau que pour l'enfant ? Une première explication avancée par Lucy Cheke et ses collègues et que les corvidés ont une compréhension au moins partielle de l'enchaînement causal entre le lancer de caillou et la montée du niveau d'eau. Ce savoir serait en fait un handicap pour le geai dans le troisième test: ils échouerait parce que faire monter le niveau d'eau dans la branche fine lui apparaîtrait impossible.

Selon Lucy Cheke, les enfants ne souffrent pas du même handicap parce qu'ils ne s'arrêtent pas à l'impossibilité apparente : ils donnent une priorité au résultat de l'action. Ils essaient donc les deux tubes larges et choisissent celui qui a l'air d'être le bon, même s'ils n'ont pas saisi l'explication de leur succès, à savoir que le tube étroit communique avec l'un des deux tubes larges.

En somme, les enfants ont plus de facilité que les oiseaux à admettre une relation causale en apparence impossible. « Les enfants partent sans a priori sur ce qui est possible et ce qui ne l'est pas, estime Lucy Cheke, interrogée dans Science. C'est pour cela qu'ils apprécient la magie, et croient toutes les histoires fantaisistes qu'on leur raconte. »

C'est sans doute tirer beaucoup de si peu mais il faut lire tout l'article et il est assez fascinant de faire de notre folie ou plutôt de notre potentiel à croire à l'absurde (le credo quia absurdum attribué à Tertullien) ce qui constitue notre supériorité sur l'étonnante intelligence des oiseaux. On pourrait parler de faculté d'imagination supérieure, ce qui paraîtrait plus plausible mais il s'agit bien au contraire d'être près à remettre en cause ce qu'on voit, de ne pas en croire ses yeux.

L'article met avec raison en avant les facteurs culturels mais le langage narratif, les mythes et les religions ont sûrement autant d'impact que les nouvelles technologies qui nous habituent effectivement à une sorte de magie, une causalité cachée. De quoi illustrer l'adage un peu idiot "ils ne savaient pas que c'était impossible, alors ils l'ont fait", ce qui ne marche bien sûr presque jamais, seulement lorsqu'on se trompe sur ce qui est vraiment impossible, mais ce presque est sans doute suffisant pour donner un avantage à la folie sur une raison trop raisonnable. En tout cas, la physique en particulier montre bien la nécessité d'avoir la capacité de croire à l'incroyable dans les sciences bien que les religions qui découlent de cette étrange faculté dogmatique soient aussi le principal obstacle aux sciences.

Ce serait donc pour s'aligner sur le chef qu'on bâillerait en choeur !

L'expérience prouve surtout que stimuler une zone du cerveau la rend plus performante lorsqu'elle est sollicitée. Il semble que la stimulation électrique suffise pour cela mais l'intérêt de l'optogénétique dans l'exploration du cerveau est indéniable et c'est un pas de plus vers son utilisation chez l'homme.

Une autre expérience a permis de faire bouger les yeux des singes et là ça devient plus horrible..

Le plus complet squelette d'Australopithecus sediba, un ancêtre de l'Homme, aurait été découvert en juin dernier dans un laboratoire.

Selon une datation basée sur la chaîne de désintégration de l'uranium, ces restes seraient âgés d'un peu moins de 2 millions d'années. Le nouvel homininé était donc contemporain d'Homo habilis, premier représentant du genre Homo. L'Homme de Malapa a surpris plusieurs scientifiques car il présentait à la fois des caractères propres aux modes de vie bipède et arboricole. Par ailleurs, plusieurs observations étaient de nature à remettre en cause certaines théories communément reconnues dans le monde de l'anthropologie, notamment la relation liant la taille du cerveau à celle du bassin. Sur la base des analyses morphologiques, il a néanmoins été admis qu'A. sebida devait être proche d'H. habilis et qu'il pourrait même correspondre à l'ancêtre d'H. erectus.

Le squelette se compose d'une partie de mâchoire, d'un fémur, de côtes, de vertèbres et d'autres éléments des membres. Ils appartiendraient à Karabo, un être qui devait avoir entre 9 et 12 ans au moment de sa mort. Il pourrait être un descendant d'A. Africanus dont l'ancêtre serait la célèbre Lucy (A. Afarensis) qui a vécu voici 3 millions d'années. Selon une étude publiée dernièrement dans la revue Nature, et contrairement aux autres australopithèques qui appréciaient se nourrir de feuilles et de plantes tendres, Karabo préférait plutôt, d'après de nombreux indices dentaires, s'alimenter en dégustant du bois et des écorces d'arbres.

Ce sont des déductions très hypothétiques et appeler cela une tâche domestique est un peu poussé à vouloir rapprocher ce travail de force de celui des femmes. Cependant, on suppose qu'il y avait moins de division des tâches chez Neandertal, les femmes participant notamment à la chasse (pour ce qu'on peut en supposer) contrairement à nos ancêtres.

Par ailleurs, ce ne serait pas le volcanisme ni un regain du froid qui pourrait expliquer la fin de Neandertal qui était déjà en voie de disparition avant.

Il a été établi qu'une terrible éruption volcanique frappait la région de Naples (Italie) il y a 40.000 ans. Celle-ci fut si violente que les cendres et autres particules ont recouvert une partie du territoire d'Europe centrale et orientale et entraîné un refroidissement global de la température. Un « hiver volcanique » en a découlé, abaissant globalement la température de tout l'hémisphère nord de 2 °C sur 3 ans.

Cette époque coïncide également avec l'arrivée des premiers Homo sapiens en provenance d'Afrique et du Moyen-Orient.

Il semble que les hommes de neandertal auraient disparus à mesure de l'avancée de Sapiens, au moins pour l'Europe de l'est car il restera un foyer en Espagne notamment, ce qui semble plaider pour une compétition entre les 2 espèces même si Neandertal était déjà en déclin avant. La plus grande question est cependant de savoir pourquoi des Sapiens se sont aventurés à l'époque dans une Europe si inhospitalière ? Pour chasser les grands mammifères ?

On date en Europe la culture moderne, celle de Sapiens, de 45 000 ans (Aurignacien ou Gravettien) mais on n'en avait pas trace en Afrique du Sud avant 22 000 ans (notamment les pointes de lance en pierre et les colliers). On retrouve désormais des dates proches de celles de l'Europe et qui pourraient correspondre aux débuts de la culture San de chasseurs-cueilleurs (perpétuée aujourd'hui par les Bushmen). Le renouveau culturel pourrait être plus ancien (on parle d'une catastrophe il y a 70 000 ans, d'un goulot d'étranglement, il y a 60 000 ans) et situé en Afrique centrale ou de l'ouest. Cependant, plutôt qu'une propagation rapide, par remplacement des populations, on aurait assisté à des changements graduels (par imitation ou endogènes?), conservant des éléments anciens.

Futura-Sciences aborde la question mais fait une grossière erreur en parlant de "l'apparition de la culture moderne" il y a 44 000 ans alors que c'est seulement en Afrique du Sud !

La première vague de migration, il y a environ 15.000 ans, a laissé sa signature génétique dans la très grande majorité des populations amérindiennes, du Nord du Canada au sud de l'Argentine, des Algonquins du Québec, aux Mayas du Guatemala, jusqu'aux Yaghans de Terre de Feu, expliquent les chercheurs dans leur article. « Deux autres vagues de migration ont contribué au peuplement du nord de l'Amérique », précise Stéphane Mazières, du Laboratoire Anthropologie bio-culturelle (CNRS/Aix Marseille Université/EFS), qui a participé à cette étude. Elles ont contribué au peuplement de l'Alaska et du Canada (peuples Eskimo-Aléoutes et Chipewyans).

Là où la génétique ne permet pas de remonter au-delà de 15.000 à 20.000 ans, l'archéologie offre des preuves d'une occupation humaine beaucoup plus ancienne, en particulier au sud. En attestent les outils de Pedra Furada, au Brésil, vieux de 30.000 ans, les empreintes de pas humains dans la cendre volcanique du Cerro Toluquilla, au Mexique, âgées de 38.000 ans, etc.. Une autre hypothèse émerge de ces fouilles : l'installation de Paléoaméricains, qui pourraient être apparentés aux Austro-Mélanésiens, qui auraient été remplacés par les ancêtres des actuels natives.

Voir aussi Techno-Science et Futura-Sciences.

Les poules ont été domestiquée vers -3400 ans dans le sud-est asiatique ne faisant donc pas partie des animaux domestiques du néolithique originel du Moyen-Orient (vaches, moutons, chèvres, ânes, chats).

Plutôt bien préservés, en position foetale, ils étaient constitués de plusieurs corps, sans aucun lien de parenté. L'un des squelettes possédaient même des os ayant une différence d'âge de plusieurs centaines d'années. Un véritable mystère qui remet en cause toutes les théories sur le traitement des morts par les hommes préhistoriques.

Christoph Zollikofer, anthropologue de son état, se sert quotidiennement de ses modèles informatiques et imprimés en 3D pour ses recherches sur l'homme de Néandertal. Les modèles sont parfaits pour les mesures tandis que les os imprimés permettent de mieux en visualiser les interactions.

La variante HMGA2 joue un rôle dans la taille du cerveau, mais aussi sur l'intelligence. L'ADN est une molécule composée de quatre bases azotées différentes : l'adénine, la thymine, la cytosine et la guanine. Les personnes dont le gène HMGA2 comporte de la cytosine à la place de la thymine ont un cerveau plus grand et obtiennent des scores plus importants à des tests de QI.

Il faudrait dire plutôt qu'il a rattrapé celui des hommes, ne le dépassant que de très peu mais au moment où le QI des hommes observe un plancher voire un léger recul après une progression de 10 à 20% le siècle passé.

En résumé : lorsqu’elles sont fertiles, elles dévalisent les boutiques de vêtements et de cosmétiques, quand elles ne le sont plus, elles se ruent sur la nourriture !

Lorsqu’elles sont fertiles, elles cherchent à plaire et se font belles (et mangent moins). Lorsque les délais sont passés pour ce mois, elles se focalisent sur leur survie et font des réserves caloriques pour leur progéniture.

Ce n'est pas entièrement nouveau car on pouvait analyser déjà par le regard si une personne mentait ou si elle n'écoutait plus mais là les chercheurs auraient développé un algorithme permettant de prévoir ce qu'on va dire et dont l'utilité serait surtout d'améliorer l'interface avec l'homme par une meilleure compréhension du langage. C'est une des nouvelles les plus étonnantes du mois.

Santé

génétique, traitements, nutrition, hygiène

Une cellule normale se divise en deux (donne deux cellules identiques) par le biais de la mitose.

Cette limitation est réalisée par le fait que les cellules doivent comporter le même matériel génétique. Ce n'est pas le cas des cellules tumorales. La vitesse de reproduction des tissus est accrue de 200 à 300 % environ : il peut y avoir jusqu'à 5 cellules en fin d'un processus élémentaire de reproduction !

Ce n'est pas nouveau mais le microenvironnement est déterminant dans les cancers, ce qui renvoie aux approches holistes de la maladie mais il ne faut pas tomber dans l'excès de croire qu'il suffit d'avoir une vie saine pour ne pas avoir de cancer, notamment parce qu'il y a différents types de cancer.

La fusion de deux gènes serait à l'origine de glioblastomes du fait que cela entraînerait la multiplication des chromosomes.

Une équipe de chercheurs de l'Université McMaster (Ontario, Canada) à découvert que la thioridazine, médicament généralement utilisée en tant qu'antipsychotique, tue efficacement les cellules souches cancéreuses chez l'homme sans les effets secondaires des traitements conventionnels du cancer. Selon les auteurs de l'étude, l'aspect exceptionnel de la thioridazine vient du mode d'élimination des cellules souches cancéreuses ; celle-ci les transforme en cellules non cancéreuses. De plus, contrairement à la chimiothérapie et aux traitements par radiations, la thioridazine semble n'avoir aucun effet sur les cellules souches normales.

Le mode de fonctionnement de la thioridazine passe par les récepteurs de dopamine situés en surface des cellules cancéreuses des patients atteints de leucémie ou de cancer du sein.

Un virus modifié avec des copies d'un gène qui code la protéine DNA methyltransferase (Dnmt3a2) et injecté dans l'hippocampe, a restauré chez des souris âgées les performances de mémorisation des plus jeunes. La protéine modifie la méthylation de l'ADN, c'est-à-dire l'addition d'un groupe méthyl à l'ADN, et donc l'expression de plusieurs gènes. Cette protéine étant produite par l'activité du cerveau, on peut en conclure que l'activité cérébrale est en soi un facteur d'amélioration de la mémoire.

La Rapamycine dont on avait déjà parlé et qui est utilisé contre le rejet d'organe améliorerait aussi la mémoire (ainsi que l'anxiété) mais c'est un anti-immunitaire trop puissant.

Ces chercheurs ont découvert que les cobayes nourris avec un régime riche en DHA présentaient des niveaux de DHA de 30 pour cent plus importants des dans la zone du cerveau dédiée à la mémoire, l'hippocampe, que ceux régulièrement nourris par une alimentation plus classique. "Nous voulions déterminer comment l'absorption de poisson améliore la mémoire", annonce Sauvé. "Ce que nous avons découvert, c'est que les cellules de la mémoire dans l'hippocampe pourraient communiquer entre elles de manière plus efficace, et mieux relayer des messages quand les niveaux de DHA deviennent plus importants dans cette région du cerveau. Cela pourrait expliquer pourquoi la mémoire s'améliore avec un régime riche en DHA".

Après une semaine de conditionnement - l'équivalent d'environ 20 mois a une échelle humaine - les chercheurs ont injecté un virus dans les rats, provoquant une augmentation de l'enzyme PKMzeta. C'est alors que les rats ont démontré une augmentation de leur aversion à l'eau douce. Précédemment, l'inhibition de PKMzeta dans le cerveau a été prouvée effacer la mémoire à long terme des rats.

PKMzeta, qui se situe entre les synapses du cerveau, semble stimuler les signaux entre les neurones en améliorant leur connectivité. Cela met en évidence un canal dans le cerveau qui pourrait renforcer la présence des souvenirs.

On avait déjà parlé de la protéine PKM-zeta en 09/06 et 09/07 mais plutôt sa suppression pour effacer les souvenirs.

Un traitement existant semble arrêter la maladie, nommé "Ig intraveineux" ou IVIg et constitué d'un extrait de plasma de donneurs de sang sains, supposé contenir des anticorps s'attaquant à la maladie. Le traitement est cependant très coûteux (3000$ pour 2 semaines!) mais cela renforce le bénéfice d'un sang frais déjà constaté (notamment par les sportifs et vedettes du showbiz). On devrait cependant pouvoir extraire le principe actif de ce traitement pour le rendre moins cher.

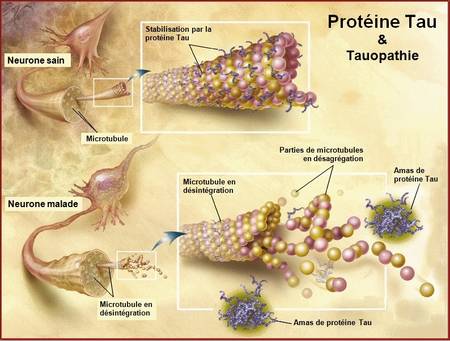

Par ailleurs, on pourrait restaurer la mémoire avec des cellules souches et détecter l'Alzheimer 25 ans avant ses effets visibles. Il y a aussi une nouvelle molécule, l'épithilone D (EpoD), qui semble efficace contre la protéine Tau. Par contre le médicament de Pfizer contre l'Alzheimer s'avère décevant.

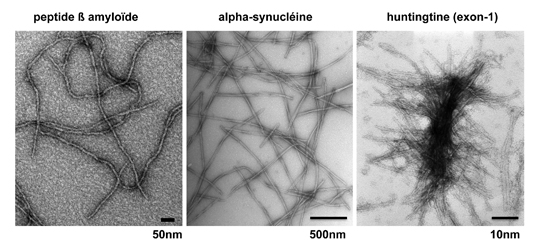

La mort des cellules neuronales au cours des maladies neurodégénératives est provoquée par des assemblages protéiques fibrillaires et non par les formes oligomériques qui en sont les précurseurs.

"Même si la restriction calorique semble améliorer la santé en général, pendant de nombreuses années nous avons tenté de trouver des effets bénéfiques dans nos modèles de neurodégénérescence, explique le chercheur. Or, il n'y avait que peu ou pas d'effet et dans certains cas, cette approche a même empiré les choses." Devant cet échec, le professeur Parker et son équipe ont pris le chemin inverse. Au lieu d'assujettir les vers à une restriction calorique, ils les ont traités avec des niveaux élevés de glucose. Le résultat fut étonnant.

"À notre grande surprise, on a observé chez les vers traités avec des niveaux élevés de glucose une réduction importante de la neurodégénérescence et ce, dans tous nos modèles !" explique Alex Parker. Le chercheur croit que les neurones malades ont un déficit énergétique et que cet apport en glucose leur fournit les ressources nécessaires pour fonctionner normalement et lutter contre la dégénérescence. Mais, il y a un prix à payer. Même si les vers démontrent moins de neurodégénérescence, en général ils sont en moins bonne santé et vivent moins longtemps.

Le microARN-7a se trouve à l'origine de la régionalisation des cellules souches dans les parois ventriculaires du cerveau adulte. Sa présence dans les cellules souches latérales empêche l'expression d'une protéine essentielle à la fabrication des neurones dopaminergiques, laissant ainsi cette spécificité aux cellules souches dorsales. En modulant l'activité de ce microARN, il est alors envisageable de générer des neurones à dopamine pouvant remplacer ceux qui dégénèrent au cours de la maladie de Parkinson.

Il pourrait y avoir un lien entre le déclenchement du Parkinson et une forte grippe.

Les nanoparticules pénétrant la peau, on pourrait ainsi injecter des petits ARN interférents (siRNA) de façon simple et efficace.

Il y a un premier essais clinique de thérapie par les ARN interférents.

Il s'agit de particules en polymère synthétique. Ces particules peuvent circuler dans le système sanguin et vont se concentrer au niveau des vaisseaux bloqués en captant une modification de débit. Une fois près du caillot, elles vont y adhérer et émettre une substance qui va les dissoudre.

On peut voir une vidéo. Voir aussi Techno-Science.

Un groupe de médecins, biologistes et ingénieurs a mis au point des microparticules rapidement injectables dans le sang, restaurant son taux d'oxygène.

À la base, il s'agit de particules inspirées par celles déjà utilisées comme vecteur de substances actives dans les tissus pour la chimiothérapie ou comme « colorants » pour des échographies. Mais contrairement à leurs cousines qui libèrent leurs produits lentement, ces microparticules se dissolvent très rapidement dans le sang en libérant de l'oxygène.

Pour l'instant, la quantité qu'il faudrait injecter limiterait son utilisation à 15 voire 30 minutes.

Voir aussi Gizmodo.

Des chercheurs de l'Université de Floride ont développé ce qu'ils appellent une « nanozyme ».Elle est basée sur les nanoparticules d'or, créées dans les années 1990 par Naomi Halas.

Ces nanozymes ont une surface composée de deux agents biologiques. L'un est une enzyme qui attaque et détruit l'ARN qui transmet l'hépatite et lui permet de se dupliquer . L'autre agent est une courte chaîne d'ADN qui identifie les cellules atteintes et envoi l'enzyme les détruire.

Testée sur des souris, la nanozyme affiche une efficacité proche des 100% et sans effet secondaire.

Ce projet s'appuie sur la recherche de l'absorption et de la désorption de molécules bioactives sur la superficie des argiles, dans le but de dessiner et de développer de nouveaux matériaux nano fonctionnels d'origine naturelle permettant une libération modifiée de molécules bioactives, qui sont des systèmes naturels plus harmonieux avec l'environnement que d'autres synthétiques préexistants.

ZetrOZ, spécialisée dans le matériel médical, a développé uPill, une pilule qui émet des ultrasons et facilite l'absorption digestive des médicaments. Le cachet serait recouvert de la substance active et les ultrasons se déclencheraient une fois le dispositif avalé. La pilule est conçue pour résister aux sucs digestifs acides et s'élimine par les voies naturelles.

Cette pilule traçable vient de recevoir l'agrément de la FDA américaine pour commercialisation.

Il s'agit en fait d'ajouter une couche de magnesium et de cuivre à un médicament (ou d'en prendre un avec cette double couche) pour qu'il délivre un signal électrique lorsqu'il est digéré, prouvant ainsi à un capteur externe (relié à son téléphone) qu'on a bien pris le médicament.

C'est utile pour l'Alzheimer mais assez dramatique pour ceux à qui on donne des psychotropes trop puissant qui les assomment et qu'ils ne pourront plus feindre d'avoir pris...

Un faible taux de testostérone accroît les amas de graisse dans le bas du corps en modifiant la fonction des cellules adipeuses.

L'étude met en lumière la façon dont la testostérone détermine la répartition des stocks de cellules adipeuses et indique que le stockage se fait différemment chez les hommes présentant un taux de testostérone peu élevé. Chez ces derniers, comme chez les femmes, les graisses se logent davantage dans les hanches et les cuisses.

Il semblerait que le taux d'une protéine, qui contribue à piéger le gras dans les cellules, soit beaucoup plus élevé dans les cellules des cuisses des sujets masculins au taux de testostérone faible. La testostérone contrôlerait donc la distribution de la masse adipeuse en influant sur les protéines qui emprisonnent les graisses.

Pour juguler l'obésité, ce nouveau vaccin recourt à une forme modifiée de somatostatine, une hormone peptidique. Chez les souris mais aussi chez l'Homme, la somatostatine inhibe l'action de l'hormone de croissance et permet la perte de poids.

Des essais sont fait en prenant des épices (capsaïcine du piment ou de la cannelle) mais l'effet éventuel devrait prendre des années.

Le cannabis aiderait à brûler plus de graisses, réduire le cholestérol, accroître la sensibilité à l'insuline et devrait permettre de soulager ceux atteints du syndrome métabolique et du diabète de type 2. C'est en conformité avec la brève précédente puisque les récepteurs cannabiniques sont apparentés à la capsaïcine. Bien qu'il donne de l'appétit, il pourrait aussi supprimer l'appétit pendant une brève période.

Sinon, une étude sur les souris a montré que les effets sur la mémoire à court terme du cannabis passerait par les récepteurs CB1 des astrocytes de l'hippocampe dont la fonction dans la mémoire n'était pas connu jusqu'ici.

Les chances de récidiver sont d'autant plus élevées si deux parties bien précises du cerveau, liées au sentiment et à la motivation, communiquent bien entre elles. En regardant la communication entre le cortex préfrontal et le noyau accumbens, les chercheurs ont pu prédire si le patient allait développer des douleurs chroniques.

Le cortex préfrontal est la partie où siègent des fonctions cognitives de premier ordre comme le langage, la mémoire. Un de ces éléments, nommé cortex orbitofrontal, est impliqué dans le processus affectif. Le noyau accumbens, lui, est une structure majeure du système de récompense. Il est un centre important d'apprentissage du cerveau permettant de réagir au monde extérieur.