Il est difficile de mesurer à quel point, bien au-delà de leur utilité immédiate, les modèles de langage génératifs comme ChatGPT vont bouleverser nos représentations du monde et donc le changer profondément, religions, idéologies, philosophies devenant instantanément obsolètes. En cela, on peut dire que l'IA va bien détruire les anciennes civilisations mais ce sera par la révélation (si déceptive) du fonctionnement de notre esprit. En effet, partout on répète à foison que ces intelligences artificielles n'ont rien à voir avec notre propre intelligence or il n'y a rien de plus faux.

Il est difficile de mesurer à quel point, bien au-delà de leur utilité immédiate, les modèles de langage génératifs comme ChatGPT vont bouleverser nos représentations du monde et donc le changer profondément, religions, idéologies, philosophies devenant instantanément obsolètes. En cela, on peut dire que l'IA va bien détruire les anciennes civilisations mais ce sera par la révélation (si déceptive) du fonctionnement de notre esprit. En effet, partout on répète à foison que ces intelligences artificielles n'ont rien à voir avec notre propre intelligence or il n'y a rien de plus faux.

Certes il est exact qu'elles n'ont aucune conscience ni même compréhension de ce qu'elles produisent et il est indéniable qu'il leur manque plusieurs dimensions de notre psychisme. Il y a d'abord l'absence des dimensions biographiques et morales (un long apprentissage par renforcement et la construction de récits de soi) qui constituent notre véritable conscience personnelle - qui est bien essentiellement une conscience morale impliquant une compréhension de sa situation - mais, de plus, comme on va le voir, il manque au simple niveau cognitif (pour peu de temps encore?) l'indispensable complémentarité entre intuition ou perception et raison (soulignée d'Aristote à Kant) y compris pour la production de langage, la fonction critique de l'intelligence, l'esprit qui dit non, modérant la crédulité et le conformisme de la pensée. Ce dualisme des processus utilisés, un peu comme les "réseaux adverses", est effectivement incontournable pour valider l'insertion de l'information reçue dans une base de connaissances fiable.

Sauf que ces vérifications sont beaucoup moins omniprésentes qu'on ne le suppose dans ce qu'on dit, la plupart du temps très semblable au traitement automatique des modèles génératifs de langage, qui reproduisent d'ailleurs tout autant la connerie humaine, ce qui a été dénoncé dès le début. La fiabilité de wikipédia avait été dénigrée de la même façon, non sans raisons mais sans que cela n'annule les apports considérables de l'encyclopédie (en progrès). Il ne s'agit pas de faire croire qu'on aurait avec ChatGPT une intelligence parfaite, seulement une intelligence au moins aussi imparfaite que la nôtre mais ayant accès à plus de sources. On peut considérer du reste la connerie comme l'inévitable conséquence d'un apprentissage qui n'est pas tiré de l'expérience mais de ce qu'on nous a dit depuis l'enfance, apprentissage forcément servile et dogmatique, lié de plus à nos appartenances, arrivant à nous faire croire au Père Noël. Pas étonnant que cette connerie se soit retrouvée dans les IA précédentes, reprenant toute la connerie humaine telle qu'elle s'exprime abondamment sur les réseaux sociaux - ce qui les avait disqualifiées. Il a donc fallu y remédier (partiellement) par des corrections programmées, pour être simplement utilisables, tout comme on ne peut se passer de modération dans les forums. Cela montre quand même qu'on est loin de l'idéal rêvé et que, comme toujours, il n'y aura pas que des conséquences positives à cette révolution cognitive qui n'est pas immunisée contre toute connerie ni contre son détournement vers des usages dangereux. Non, mais leurs performances remarquables tout autant que leurs faiblesses posent de nouvelles questions à notre compréhension de l'intelligence et de notre propre pensée, décidément devenue sans mystère et débarrassée de cette supériorité qui faisait notre orgueil.

Ce qu'on ne dit pas assez, en effet, voire pas du tout, c'est que l'IA et la neuro-imagerie progressent ensemble depuis l'utilisation des réseaux de neurones. Il vaudrait mieux faire savoir qu'on a ainsi avec ces modèles de langage un fonctionnement à peu près identique à celui du cerveau humain pour traiter le langage, basé de façon très surprenante sur la mémoire à court terme et la prédiction du mot suivant en fonction du mot précédent et du contexte, tout comme ChatGPT, procédure très simple mais qui se révèle étonnamment puissante. On le sait depuis octobre 2021 au moins et j'avais déjà souligné en avril 2022 l'importance de cette nouvelle convergence entre l'Intelligence Artificielle et le fonctionnement du cerveau, mais il faut avouer que cette découverte assez incroyable restait abstraite avant d'avoir pu la tester et avoir constaté les prouesses époustouflantes de ce mécanisme minimal (avant d'en éprouver toutes les limites malgré tout). Pour parler et répondre, il suffirait donc d'appliquer la règle la plus simple qui est de dire ce qui est la norme, le mot qu'on attend de nous, c'est-à-dire trouver le mot le plus probable à dire dans cette circonstance pour compléter les phrases et les conversations. [C'est un peu plus compliqué, il faut ajouter un certain nombre de "réglages fins", en fonction du contexte et de l'expérience, corrigeant des erreurs courantes mais le mécanisme reste bien , comme dans le cerveau, la prédiction du mot suivant]. En tout cas, comme toute découverte scientifique, ce n'est pas du tout une invention humaine, les sciences depuis Galilée contredisant systématiquement nos anciennes théories, déshumanisant notre savoir en l'universalisant, et ce truc qui semble miraculeux n'est encore une fois qu'une imitation du vivant et de ses processus d'apprentissage, consistant neurologiquement à prédire ce qui doit suivre pour comparer ensuite avec ce qui arrive vraiment (prédiction récompensée ou non par la dopamine).

On avait abordé, dans

On avait abordé, dans

Selon

Selon

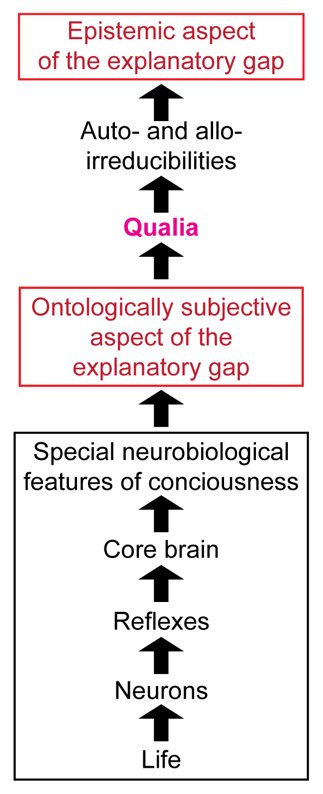

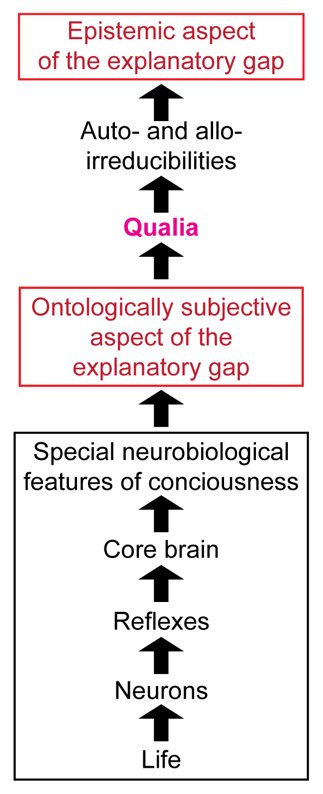

Les progrès rapides de l'Intelligence Artificielle et de l'étude du cerveau posent à nouveaux frais la question de la conscience dont on voudrait doter les robots, imaginant le pire et mettant du coup en question notre identité humaine. C'est qu'il y a confusion entre différents niveaux de conscience. Il y a sans conteste une conscience qu'on peut dire animale ou cognitive, se distinguant de l'inconscience totale des automatismes ordinaires et impliquant une certaine conscience de soi, de sa position dans l'espace. On voit bien cependant que cela n'a rien à voir avec notre propre conscience qu'Alain assimilait à la conscience morale et qui est plus largement une conscience sociale et de notre responsabilité, ce qui constitue notre identité. Or, celle-ci n'est pas réductible au calcul ni à l'imitation mais implique le langage narratif, condition d'un monde commun, ainsi qu'un récit de soi, condition de l'individuation. On s'éloigne ainsi du cognitivisme comme de la crainte de pulsions maléfiques prêtées à tort aux machines pour retrouver les pulsions maléfiques des humains qui se racontent des histoires...

Les progrès rapides de l'Intelligence Artificielle et de l'étude du cerveau posent à nouveaux frais la question de la conscience dont on voudrait doter les robots, imaginant le pire et mettant du coup en question notre identité humaine. C'est qu'il y a confusion entre différents niveaux de conscience. Il y a sans conteste une conscience qu'on peut dire animale ou cognitive, se distinguant de l'inconscience totale des automatismes ordinaires et impliquant une certaine conscience de soi, de sa position dans l'espace. On voit bien cependant que cela n'a rien à voir avec notre propre conscience qu'Alain assimilait à la conscience morale et qui est plus largement une conscience sociale et de notre responsabilité, ce qui constitue notre identité. Or, celle-ci n'est pas réductible au calcul ni à l'imitation mais implique le langage narratif, condition d'un monde commun, ainsi qu'un récit de soi, condition de l'individuation. On s'éloigne ainsi du cognitivisme comme de la crainte de pulsions maléfiques prêtées à tort aux machines pour retrouver les pulsions maléfiques des humains qui se racontent des histoires...

On est bien obligé de constater que notre monde a radicalement changé depuis quelques années, avec internet puis les mobiles, mais on n'a rien vu encore et, avec l'arrivée de l'Intelligence Artificielle, rien ne sera plus comme avant malgré toutes les résistances au changement qui détruit l'ordre ancien.

On est bien obligé de constater que notre monde a radicalement changé depuis quelques années, avec internet puis les mobiles, mais on n'a rien vu encore et, avec l'arrivée de l'Intelligence Artificielle, rien ne sera plus comme avant malgré toutes les résistances au changement qui détruit l'ordre ancien.

L'humanité a le chic pour se créer de faux problèmes, qui la détournent des vrais, et s'effrayer de sa propre disparition mais non pas pour des raisons écologiques, qu'elle néglige au contraire beaucoup trop, alors que cela pourrait faire de très nombreux morts. Non, ce qui est redouté, c'est la probable fin de notre espèce comme telle, à très long terme et sans faire aucune victime, par la faute de la génétique, des robots ou de l'intelligence artificielle (comme, pour d'autres, ce serait la faute du féminisme, de l'homosexualité ou autre transgression des normes) ! On ferait mieux de s'occuper des êtres humains qui partout sont en souffrance, mais non, on s'inquiète de l'Humanité avec un grand H, comme avant de la race des seigneurs!

L'humanité a le chic pour se créer de faux problèmes, qui la détournent des vrais, et s'effrayer de sa propre disparition mais non pas pour des raisons écologiques, qu'elle néglige au contraire beaucoup trop, alors que cela pourrait faire de très nombreux morts. Non, ce qui est redouté, c'est la probable fin de notre espèce comme telle, à très long terme et sans faire aucune victime, par la faute de la génétique, des robots ou de l'intelligence artificielle (comme, pour d'autres, ce serait la faute du féminisme, de l'homosexualité ou autre transgression des normes) ! On ferait mieux de s'occuper des êtres humains qui partout sont en souffrance, mais non, on s'inquiète de l'Humanité avec un grand H, comme avant de la race des seigneurs!